KI-Telefonassistenten in Arztpraxen: Effizienzgewinn, Governance-Risiko oder beides?

KI-basierte Telefonassistenten in Arztpraxen werden oft als reine Entlastungsmaßnahme verkauft: bessere Erreichbarkeit, weniger Last am Empfang, strukturiertere Anfragen. Diese Perspektive ist nachvollziehbar — aber unvollständig.

Denn im Gesundheitswesen ist ein Praxistelefon kein gewöhnlicher Kommunikationskanal. Es ist ein Zugangspunkt zu einer Verarbeitung, in der sehr schnell personenbezogene Daten, Gesundheitsdaten und unter Umständen Gesprächsaufzeichnungen zusammenlaufen. Genau deshalb ist ein KI-Telefonassistent nicht bloß ein UX-Feature, sondern eine Governance-, Architektur- und Datenschutzentscheidung. Gesundheitsdaten zählen nach Art. 9 DSGVO zu den besonders geschützten Datenkategorien.

Die erste analytische Korrektur: Nicht jede Stimme ist automatisch “biometrisch”

Wer seriös über solche Systeme schreibt, muss präzise bleiben: Sprachdaten sind nicht automatisch biometrische Spezialdaten. Biometrische Daten im datenschutzrechtlichen Sinn liegen dann vor, wenn eine spezifische technische Verarbeitung zur eindeutigen Identifizierung einer Person erfolgt. Davon zu unterscheiden sind Sprachdaten als personenbezogene Daten und Gesprächsinhalte, die im medizinischen Kontext sehr schnell Gesundheitsdaten darstellen können. Die DSK weist zudem darauf hin, dass eine Einwilligung in die Gesprächsaufzeichnung keine biometrische Auswertung umfasst.

Diese Unterscheidung ist keine juristische Spitzfindigkeit. Sie entscheidet darüber, welche Rechtsgrundlagen, Schutzmaßnahmen und Prüftiefen tatsächlich einschlägig sind.

Das eigentliche Thema ist nicht “die KI”, sondern die Verarbeitungskette

Die naheliegende Fehlwahrnehmung lautet: Das Risiko liegt in der KI.

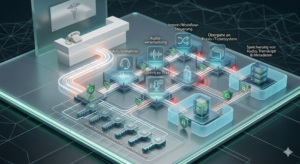

In der Praxis liegt das Risiko meist in der gesamten Systemkette, etwa:

Anrufannahme → Audioverarbeitung → Speech-to-Text → Intent-/Workflow-Steuerung → Übergabe an Praxis- oder Ticketsystem → Speicherung von Audio, Transkript und Metadaten → Nachbearbeitung durch Mitarbeiter.

Jeder Übergang schafft einen weiteren technischen und organisatorischen Kontrollbedarf. Genau diese mehrstufige Verarbeitung ist auch ein zentrales Thema der EDPB-Leitlinien zu virtuellen Sprachassistenten, die Transparenz, Datenminimierung und Privacy by Design betonen.

Wo ein belastbares Bedrohungsmodell ansetzen würde

Ein belastbarer Security-Blick fragt nicht zuerst: Kann man das hacken?

Er fragt:

Welche Assets sind schützenswert?

- Audioaufnahmen

- Transkripte

- Rufnummern und Terminmetadaten

- Rückruf- und Eskalationsdaten

- Kontextinformationen mit Gesundheitsbezug

Wo liegen die Trust Boundaries?

- zwischen Telephony-Provider und Plattform

- zwischen Plattform und Speech-/AI-Komponenten

- zwischen SaaS-Anbieter und Praxissystem

- zwischen Support-, Admin- und Praxiszugriffen

Welche Failure Modes sind realistisch?

- Fehlkonfiguration von Speicher- oder Logging-Komponenten

- zu breite interne Zugriffsrechte

- unklare oder überlange Speicherfristen

- schlechte Mandantentrennung

- schwache Authentisierung im Praxisumfeld

- unzureichende Transparenz über Subprozessoren und Datenflüsse

Der Punkt ist nicht, dass jedes dieser Systeme zwangsläufig unsicher ist. Der Punkt ist: Ohne saubere Architektur- und Kontrollnachweise kann man die Sicherheit nicht seriös behaupten.

Gesprächsaufzeichnung: der juristisch und technisch heikelste Teil

Sobald Gespräche aufgezeichnet werden, steigt die Kritikalität deutlich. Die Datenschutzkonferenz hat klargestellt, dass die Aufzeichnung von Telefongesprächen datenschutzrechtlich in aller Regel nur mit Einwilligung auch des externen Gesprächspartners zulässig ist. Diese Einwilligung muss vor der Aufzeichnung eingeholt und eindeutig erklärt werden. Ein bloßer allgemeiner Hinweis oder ein unscharfes “Wenn Sie das nicht möchten, legen Sie auf” ist aus Expertensicht nicht automatisch dasselbe wie eine sauber dokumentierte, informierte Einwilligung.

Aus Security-Sicht kommt hinzu: Audioaufzeichnungen sind besonders wertvoll, weil sie nicht nur Daten enthalten, sondern Tonfall, Kontext, Inhalt und häufig Identifikationsmerkmale kombinieren. Wer solche Daten speichert, braucht ein belastbares Lösch-, Rollen- und Zugriffskonzept — nicht nur eine freundliche Formulierung wie “temporär”.

“Temporär gespeichert” ist kein Sicherheitsmerkmal

Genau hier sind viele Texte zu weich formuliert. “Temporär” klingt datensparsam, ist aber ohne präzise Angaben praktisch wertlos. Für eine belastbare Bewertung braucht es mindestens Antworten auf diese Fragen:

- Wie lange genau werden Audio, Transkript und Metadaten gespeichert?

- Erfolgt die Löschung automatisch und revisionssicher?

- Wer kann auf Rohdaten zugreifen?

- Gibt es getrennte Rollen für Praxis, Support, Admin und Entwicklung?

- Werden Daten standardmäßig minimiert verarbeitet?

- Gibt es technisch erzwungene Lösch- und Retention-Policies?

Art. 25 DSGVO verlangt Datenschutz durch Technikgestaltung und datenschutzfreundliche Voreinstellungen. Im Klartext: Nicht der Nutzer muss aktiv Schutz herstellen — das System muss ihn standardmäßig liefern.

Das eigentliche Executive-Thema: Risikoverlagerung

Die strategisch wichtigste Frage lautet nicht, ob ein KI-Telefonassistent “modern” ist.

Die Frage lautet:

Wird operative Entlastung am Empfang mit einer Verlagerung von Risiko in Richtung Plattform, Cloud-Prozesskette und Drittparteien erkauft?

Wenn ein Anbieter oder dessen Zulieferkette Telephony, Transkription, Routing und Nachbearbeitung technisch zusammenführt, entsteht ein hochattraktiver Datenknoten. Das ist nicht automatisch ein Single Point of Failure, aber sehr wohl ein zentraler Konzentrationspunkt für Verfügbarkeit, Vertraulichkeit und Incident Impact.

Wer das professionell einführt, muss daher nicht nur an Funktionalität, sondern an Resilienz, Mandantentrennung, Vendor Oversight und Incident-Kommunikation denken.

Ältere Menschen und andere vulnerable Nutzergruppen: kein Randthema

Auch der Accessibility-Aspekt muss fachlich sauber formuliert werden. Es ist zu simpel, pauschal zu sagen, ältere Menschen kämen “mit so etwas nicht klar”. Sprachinterfaces können gegenüber Apps und Webportalen sogar barriereärmer sein. Problematisch werden sie dann, wenn sie:

- keine einfache Eskalation zu menschlichem Personal bieten,

- in freier Sprache hohe kognitive Anforderungen erzeugen,

- bei Dialekten, Hörbeeinträchtigungen oder Unsicherheit schlecht funktionieren,

- oder faktisch als Vorfilter vor menschlicher Versorgung wirken.

Die richtige Frage lautet also nicht, ob Voice an sich gut oder schlecht ist, sondern ob das System echte Wahlfreiheit lässt. Auch aus Sicht der EDPB sind Transparenz, Fairness und die Berücksichtigung vulnerabler Nutzergruppen zentrale Designfragen bei Sprachassistenten.

Was ein kritischer IT-, Legal- oder C-Level-Reviewer konkret sehen wollen sollte

Ein professionell eingeführtes System sollte sich an mindestens diesen Prüffragen messen lassen:

- Datenklassifikation: Welche Datenarten fallen tatsächlich an — Audio, Transkript, Telefonnummer, Terminmetadaten, Klassifikationen, Confidence Scores?

- Rechtsgrundlagen und Zweckbindung: Wofür genau wird was verarbeitet, und welche Teile beruhen auf welcher Rechtsgrundlage?

- Einwilligungsdesign: Wie wird eine Gesprächsaufzeichnung wirksam, dokumentiert und widerrufbar gestaltet?

- Privacy by Design: Ist Datenminimierung standardmäßig technisch durchgesetzt?

- Retention und Deletion: Gibt es präzise, technisch erzwingbare Löschfristen?

- Subprozessoren und Transfers: Welche Dienstleister verarbeiten welche Teilfunktion?

- Mandantentrennung und Zugriffskontrollen: Wie wird verhindert, dass Praxen, Support oder Admins mehr sehen als nötig?

- Incident Readiness: Wie schnell können Betroffene, Aufsicht und Kunden im Vorfall informiert werden?

- DPIA/DSFA: Wurde wegen neuer Technologie, möglicher Gesundheitsdaten und potenziell vulnerabler Betroffener eine Datenschutz-Folgenabschätzung ernsthaft durchgeführt? Die EDPB-Leitlinien zu Voice Assistants deuten für solche Konstellationen klar auf einen hohen Prüfbedarf hin.

Fazit

Der kritische Punkt ist nicht, dass eine Arztpraxis KI einsetzt.

Der kritische Punkt ist, dass hier ein medizinisch sensibler Erstkontakt in eine komplexe, potenziell plattformisierte Sprachverarbeitung überführt wird.

Das kann gut gemacht sein.

Es kann aber auch schlecht eingeführt, zu weich kommuniziert und zu schwach kontrolliert sein.

Darum ist die richtige Bewertung weder “KI ist gefährlich” noch “Doctolib oder andere etablierte Anbieter werden das schon sicher machen”. Die richtige Bewertung lautet:

Ein KI-Telefonassistent im Gesundheitswesen ist nur dann vertretbar, wenn technische Schutzmaßnahmen, rechtliche Präzision, dokumentierte Governance und echte Nutzerwahlfreiheit gemeinsam nachweisbar sind.

Alles darunter ist nicht digitale Exzellenz, sondern Risikoverlagerung mit freundlicher Ansage.